The article discusses the development of a desktop software tool for training polemics and argumentation skills. The problem of human judging subjectivity in debates is described, and a solution based on integration with the DeepSeek API is proposed. The technical implementation of the architecture using Retrieval-Augmented Generation (RAG) is presented. The testing results of the developed AI-jury algorithm are provided, proving its high statistical stability compared to human experts.

Keywords: software engineering, artificial intelligence, large language models, RAG, debates, PySide6, DeepSeek, prompt-engineering.

Введение

В условиях цифровизации все более значимую роль приобретают программные средства, предназначенные для поддержки интеллектуальной деятельности. Навыки аргументированного изложения и защиты позиции востребованы в образовательной и профессиональной среде. Однако традиционные подходы к обучению аргументации требуют участия квалифицированных тренеров или судей, что влечет за собой высокую степень субъективности оценок и низкую масштабируемость процесса.

Существующие на рынке ИИ-решения (например, ChatGPT, Yoodli) ориентированы либо на свободное общение, либо на анализ формальных характеристик речи (темп, интонация), не обеспечивая жесткого сценарного контроля дискуссии [1]. В связи с этим целью данной работы стала разработка программного средства «Интеллектуальный Гладиатор», обеспечивающего автоматизированное проведение и объективную оценку дебатов с участием виртуальных оппонентов.

Архитектура и программная реализация

Разработанное программное средство построено на базе языка Python и кроссплатформенного фреймворка PySide6. Приложение реализует паттерн проектирования MVC (Model-View-Controller) и асинхронную событийную модель управления [2].

Ключевой особенностью системы является разделение ролей ИИ-агентов. Для генерации ответов виртуальных оппонентов (например, исторических философов) используется мультиагентный подход с интеграцией локальной векторной базы данных ChromaDB. Алгоритм реализует принцип RAG (RetrievalAugmented Generation) [3]: перед отправкой запроса к LLM (DeepSeek-Chat) система находит релевантные цитаты философа в локальной базе и внедряет их в системный промпт. Это позволяет минимизировать галлюцинации и обеспечить историческую достоверность аргументации.

Интерфейс пользователя разделен на функциональные зоны, включая зону оппонента с динамической генерацией текста, информационную панель с таймерами и зону пользователя с голосовым вводом (STT) в режиме реального времени.

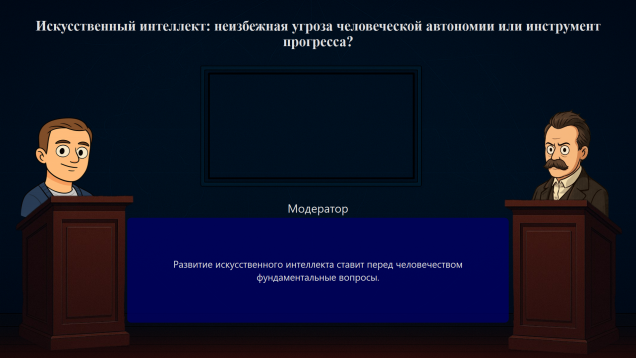

Рис. 1. Пользовательский интерфейс экрана полемики

Для оценки качества дискуссии разработан алгоритм ИИ-Жюри на базе аналитической модели DeepSeek-Reasoner. Оценка базируется на международном стандарте дебатов 3M (Matter, Manner, Method) и включает предварительный логический анализ стенограммы (Chain-of-Thought) с сопоставлением аргументов [4].

Результаты тестирования

Для верификации разработанного алгоритма ИИ-Жюри была проведена серия нагрузочных испытаний. Оценивалась детерминированность выставляемых баллов. Транскрипты раундов дебатов подавались на вход алгоритму по 5 раз независимыми итерациями (суммарно 15 прогонов). Результаты оценки дисперсии представлены в таблице 1.

Анализ результатов показал, что средний коэффициент вариации (CV) для аналитических макро-критериев составил всего 5,8 %. Нулевая дисперсия (CV = 0.0 %) в оценке логической непротиворечивости подтверждает строгую детерминированность алгоритма. Для сравнения, профессиональные эксперты-люди демонстрируют расхождение в суждениях в 19 % случаев [5]. Таким образом, разработанный LLM-судья обладает значительно более высокой точностью и повторяемостью результатов, исключая фактор случайного отклонения. Пример оценки дисперсии части баллов представлен в таблице 1.

Таблица 1

Оценка дисперсии баллов алгоритма ИИ-Жюри

|

Критерий (система 3M) |

Среднее ( µ ) |

Стд. откл. ( σ ) |

Коэфф. вариации (CV) |

|

Логическая непротиворечивость |

5.00 |

0.00 |

0.00 % |

|

Структурная связность речи |

17.80 |

0.45 |

2.51 % |

|

Качество контраргументации |

10.20 |

0.45 |

4.38 % |

|

Стилистическое богатство |

8.60 |

0.55 |

6.37 % |

Дополнительное тестирование архитектуры RAG на базе 50 раундов дебатов показало, что интеграция узкоспециализированной терминологии позволяет преодолеть склонность базовой модели к нейтральным ответам («семантическое усреднение»). Применение RAG повысило качество аргументации нишевых ИИ-персонажей в среднем на 2,2 балла по системе 3M.

Заключение

Разработанный программный модуль успешно решает задачу проведения и объективной оценки структурированных дебатов. Применение современных технологий обработки естественного языка, локальных векторных хранилищ и продуманного промпт-инжиниринга позволило создать тренажер, превосходящий стабильность экспертов-людей. Внедрение подобных систем открывает новые перспективы для автоматизации образовательного процесса и развития когнитивных навыков.

Литература:

- Sharma, M. Understanding AI Sycophancy in Large Language Models /M. Sharma, S. Tong, T. Korbak [et al.] // Journal of Machine Learning Research. — 2023. — Vol. 24, № 1. — P. 110–135.

- Мартин, Р. Чистая архитектура: Искусство разработки программного обеспечения / Р. Мартин; пер. с англ. — Санкт-Петербург: Питер, 2022.– 352 с.

- Lewis, P. Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks / P. Lewis, E. Perez, A. Piktus [et al.] // NeurIPS 2020 Proceedings. — 2020. — Vol. 33. — P. 9459–9475.

- International Debate Education Association (IDEA). Rulebook for 3M Assessment System (Matter, Manner, Method). — New York: IDEA Press, 2019. 112p.

- Zheng, L. Judging LLM-as-a-judge with MT-Bench and Chatbot Arena L. Zheng, W. L. Chiang, Y. Sheng [et al.] // Advances in Neural Information Processing Systems. — 2023. — Vol. 36. — P. 46595–46623.